区块链数据容量激增,如何突破存储瓶颈与扩展性难题?

摘要:

核心概念:区块链为什么会有数据容量问题?首先要明白,区块链本质上是一个分布式、公开、不可篡改的账本,每个区块都像一个数据页,记录着一段时间内的所有交易信息,并通过密码学方法链接成一...

摘要:

核心概念:区块链为什么会有数据容量问题?首先要明白,区块链本质上是一个分布式、公开、不可篡改的账本,每个区块都像一个数据页,记录着一段时间内的所有交易信息,并通过密码学方法链接成一... 核心概念:区块链为什么会有数据容量问题?

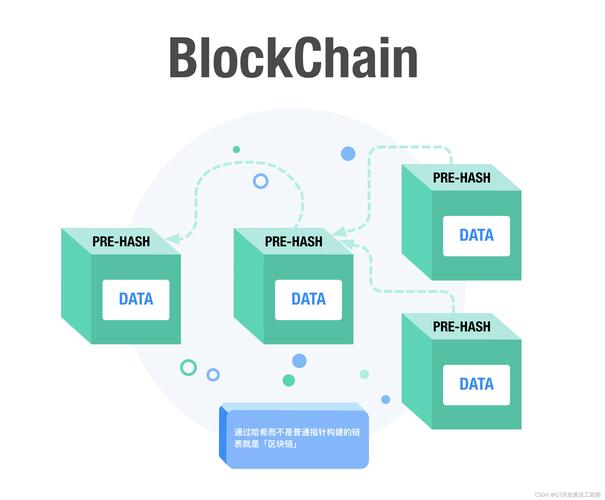

首先要明白,区块链本质上是一个分布式、公开、不可篡改的账本,每个区块都像一个数据页,记录着一段时间内的所有交易信息,并通过密码学方法链接成一条链。

数据容量问题主要源于其核心特性:

- 不可篡改性:一旦数据被写入区块并被网络确认,就几乎不可能被修改或删除,这意味着数据只增不减,永远存储在网络中(或至少是大部分节点上)。

- 去中心化:为了保证安全和信任,区块链网络中的每个全节点都需要存储完整的区块链数据,如果数据量无限增长,普通用户的设备将无法承担存储和同步的负担,导致去中心化程度降低,网络中心化风险增高。

- 数据公开透明:所有交易数据对所有人可见,不像传统数据库可以进行数据压缩、归档或删除。

区块链的数据容量问题,本质上是如何在保证去中心化、安全和透明的前提下,高效地存储和处理不断增长的数据。

主流区块链数据容量实例对比

不同区块链的设计理念不同,其数据容量也天差地别。

| 区块链类型 | 代表项目 | 单个区块大小 | 平均出块时间 | 每秒交易量 | 估算年增长数据量 | 特点与说明 |

|---|---|---|---|---|---|---|

| Layer 1 (公链) | ||||||

| 比特币 | Bitcoin | ~1.5 - 2 MB | 10 分钟 | ~7 TPS | ~100 GB/年 | - UTXO模型:主要存储交易输入输出,数据相对精简。 - 数据以“价值转移”为核心,不存储复杂智能合约代码或状态。 - 增长缓慢,但数据已超过 500 GB,全节点门槛越来越高。 |

| 以太坊 | Ethereum | ~15 - 30 MB | 12 秒 | ~15-30 TPS | ~4-5 TB/年 | - 账户模型:需要存储账户状态、智能合约代码和所有历史交易。 - 数据增长最快,因为每个交易都改变链上状态,且智能合约代码永久存储。 - 目前数据量已超过 5 TB,是最大的公链之一。 |

| Solana | Solana | ~1.2 MB | 4 秒 | ~2,000+ TPS | ~1-2 TB/年 | - 采用历史证明等创新架构,通过压缩和并行处理来降低全节点的存储负担。 - 虽然TPS高,但通过技术手段控制了数据量的爆炸性增长。 |

| Layer 2 (扩容方案) | ||||||

| Rollups (Optimistic/ZK) | Arbitrum, zkSync, Optimism | 极小 (< 1 KB) | 依赖 L1 | 高 (数千 TPS) | ~几百 GB/年 (在 L1 上) | - 核心思想:将计算和状态存储放在链下,只将交易数据(或证明)提交到 Layer 1 (以太坊)。 - 极大地减少了主链的数据负担,是当前最主流的扩容方案。 |

| 状态通道 | Lightning Network | 几乎为零 | 实时 | 极高 | 几乎为零 (在 L1 上) | - 只有通道开启和关闭时的交易会上链,期间所有交互都链下完成。 |

- 以太坊 是数据容量压力最大的公链,其“状态”的存储是核心挑战。

- Layer 2 (特别是 Rollups) 是解决数据容量问题的关键,它们通过将数据负担转移到主链,实现了极高的可扩展性。

- 比特币 的数据模型更简单,增长较慢,但随着全节点数据超过 500GB,也面临中心化风险。

影响区块链数据容量的关键因素

- 区块大小:最直观的因素,区块越大,每个区块能容纳的交易越多,数据增长越快,但过大的区块会导致出块慢、网络拥堵。

- 出块时间:出块越快,单位时间内产生的区块越多,数据增长也越快。

- 交易类型与复杂度:

- 简单转账(如比特币):只记录发送方、接收方和金额,数据量小。

- 智能合约交互(如以太坊):需要记录调用方法、参数、状态变更等,数据量大得多。

- 状态存储:这是以太坊等“状态型”区块链的特有问题,每个账户的余额、每个智能合约的变量都需要持续存储,随着用户和合约增多,状态数据会不断膨胀。

- 数据存储策略:

- 永久存储:所有历史数据都保留。

- 修剪:节点可以选择只保留最近 N 个区块的数据,放弃更古老的数据,这会牺牲部分历史数据的可验证性,但能大幅节省空间,比特币 Core 客户端支持修剪,但以太坊目前不支持。

数据容量带来的挑战

- 全节点门槛提高:普通用户电脑无法运行全节点,导致网络参与者减少,中心化风险增加,网络的安全性依赖于足够多的独立全节点。

- 同步时间延长:新加入的节点需要下载和验证全部历史数据,可能需要数天甚至数周,用户体验极差。

- 存储成本高昂:需要购买和维护大容量硬盘(通常是高速 SSD),持续的电费和硬件成本成为负担。

- 网络性能下降:节点在查询和广播数据时,需要处理更大的数据量,可能导致网络延迟。

解决方案与发展方向

社区和开发者们正在从多个层面解决这个问题:

Layer 1 (链上) 优化

- 分片:将区块链网络分割成多个并行的“分片”,每个分片处理自己的交易和状态,从而并行处理数据,分担主链的存储压力。以太坊 2.0 的路线图就包含了分片技术。

- 状态租约/租金:让用户为存储在链上的数据支付“租金”,长期不活跃的数据需要支付更高的费用,或最终被“归档”,以激励用户清理不需要的状态数据。

- 数据可用性采样:这是一种巧妙的技术,节点不需要下载所有数据来验证其完整性,而是通过随机下载一小部分“样本”来以极高的概率推断出全部数据是可用的,这大大降低了验证数据可用性的成本。以太坊 Dencun 升级就引入了 EIP-4844 协议,通过“Proto-Danksharding”为 Rollups 提供了廉价的数据可用性层。

- 改进数据结构:研究和使用更高效的数据结构来存储状态,减少冗余。

Layer 2 (链下) 扩容

- Rollups (汇总):是目前最成功的方案,它们将计算和状态存储放在链下,只将压缩后的交易数据或零知识证明提交到 L1,L1 只需负责验证结果,极大地节省了 L1 的空间和计算资源。

- Optimistic Rollups (乐观汇总):假设交易是有效的,允许任何人挑战,如果挑战成功则交易回滚。

- ZK-Rollups (零知识汇总):使用零知识密码学生成一个证明,证明所有交易的有效性,无需挑战。

- 状态通道:适用于高频、点对点的交易(如支付),完全链下交互,只在通道开启和关闭时与主链交互。

归档节点 与全节点分离

- 区块网络可以存在两种节点:

- 全节点:只存储最近的数据,负责验证新区块,保证网络实时安全,门槛较低,鼓励更多人运行。

- 归档节点:存储完整的、全部的历史数据,它们不参与实时共识,但为历史数据查询、安全审计和研究提供支持,可以由专业机构或云服务商运行,门槛较高。

区块链数据容量是其“不可能三角”(去中心化、安全性、可扩展性)中的核心挑战之一,以太坊等“状态型”公链面临着最严峻的挑战。

- 现状:以太坊等主链的数据量已达到 TB 级,并以每年数 TB 的速度增长,给全节点带来了巨大压力。

- 短期解决方案:Layer 2,特别是 Rollups,是当前最有效的扩容和数据分流方案,它们通过将大部分计算和状态存储移至链下,极大地缓解了主链的压力。

- 长期发展方向:以太坊 2.0 的分片、数据可用性采样等技术,以及更底层数据结构的创新,旨在从根本上解决链上数据膨胀的问题,实现一个既能保持去中心化,又能容纳海量应用的区块链网络。

区块链能否承载全球级的数字应用,很大程度上取决于这场围绕数据容量的“攻坚战”能否取得成功。

文章版权及转载声明

作者:咔咔本文地址:https://www.jits.cn/content/31901.html发布于 04-05

文章转载或复制请以超链接形式并注明出处杰思科技・AI 股讯

还没有评论,来说两句吧...