摄像实时数据处理如何突破低延迟与高并发的技术瓶颈?

摘要:

下面我将从核心概念、关键技术、应用场景、挑战与解决方案四个方面,全面地为您解析摄像实时数据处理,核心概念:实时处理流水线摄像实时数据处理的核心是一个“流水线”(Pipeline)模...

摘要:

下面我将从核心概念、关键技术、应用场景、挑战与解决方案四个方面,全面地为您解析摄像实时数据处理,核心概念:实时处理流水线摄像实时数据处理的核心是一个“流水线”(Pipeline)模... 下面我将从核心概念、关键技术、应用场景、挑战与解决方案四个方面,全面地为您解析摄像实时数据处理。

核心概念:实时处理流水线

摄像实时数据处理的核心是一个“流水线”(Pipeline)模型,数据像流水一样,依次经过各个处理阶段,最终输出结果,一个典型的流水线包括以下几个关键步骤:

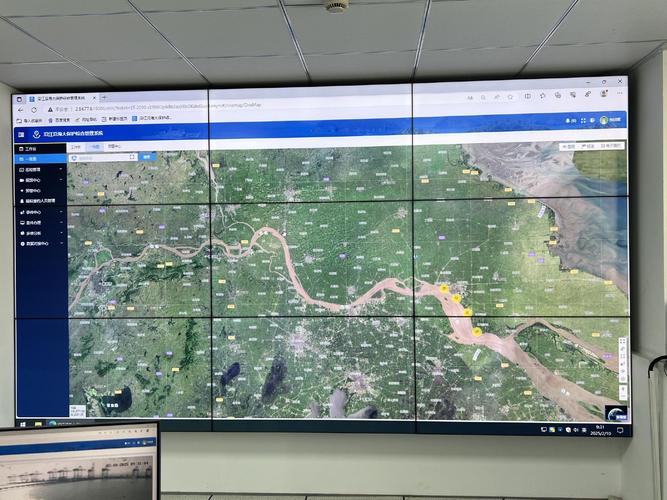

(图片来源网络,侵删)

-

数据采集

- 来源:摄像头(网络摄像头、工业相机、手机摄像头等)、视频流文件、屏幕录制等。

- 关键点:确保数据源的稳定性和低延迟,对于网络摄像头,需要考虑网络抖动和带宽。

-

数据预处理

- 目标:为后续算法处理“清洗”和“准备”数据。

- 操作:

- 解码:将压缩的视频流(如 H.264, H.265)解码成原始的图像帧。

- 格式转换:将图像转换为算法所需的格式(如 RGB, BGR, YUV)。

- 尺寸调整/归一化:将所有图像缩放到一个统一的尺寸,以满足模型输入要求。

- 色彩空间转换:根据算法需求进行转换(如 RGB 转 HSV 用于颜色分割)。

-

核心算法处理

- 目标:这是流水线的“大脑”,执行具体的分析任务。

- 常见算法:

- 计算机视觉:目标检测、图像分类、人脸识别、姿态估计、光学字符识别、图像分割等。

- 视频分析:行为识别、目标追踪、场景理解、异常检测等。

- 图像增强:去噪、超分辨率、图像稳定、低光增强等。

-

后处理与结果输出

(图片来源网络,侵删)- 目标:将算法的原始输出“翻译”成可用的信息,并进行展示或存储。

- 操作:

- 非极大值抑制:在目标检测中,去除重叠的冗余框。

- 数据关联:在目标追踪中,将当前帧的目标与上一帧的目标关联起来。

- 结果渲染:在图像上绘制边界框、关键点、文字标签等。

- 数据封装:将处理结果(如 JSON 格式的坐标、类别、置信度)打包。

-

数据传输与呈现

- 目标:将最终结果传递给用户或其他系统。

- 方式:

- 实时视频流:将处理后的视频流推送到 Web、RTSP、WebRTC 等平台。

- API 接口:通过 RESTful API 或 WebSocket 将结构化数据(如检测到的物体列表)发送给其他应用。

- 本地显示:在监控屏幕上直接显示处理后的画面。

关键技术

要实现高效的实时数据处理,需要掌握以下关键技术:

编程语言与框架

- Python:AI 和计算机视觉领域的首选语言,拥有丰富的库。

- OpenCV:计算机视觉的“瑞士军刀”,提供图像处理、视频 I/O、基础算法等。

- NumPy:高效的数值计算库,用于处理图像数据。

- PyTorch / TensorFlow:深度学习框架,用于构建和部署复杂的神经网络模型。

- C++:性能之王,常用于对性能要求极高的场景,如底层库、游戏引擎、嵌入式系统。

- OpenCV C++ API:性能远超 Python 版本。

- Intel oneAPI:提供优化的数学库和视频处理库。

- GStreamer:一个强大的多媒体框架,通过“插件”化的方式灵活构建复杂的音视频处理流水线,非常适合处理网络流和硬件加速。

硬件加速

实时处理对计算能力要求极高,纯 CPU 往往无法满足需求,因此硬件加速至关重要。

- GPU (图形处理器):并行计算能力极强,是深度学习模型推理的首选。

- NVIDIA CUDA:NVIDIA GPU 的并行计算平台和 API,TensorFlow, PyTorch 等框架都深度支持。

- 推理优化:使用 TensorRT, ONNX Runtime 等工具对模型进行优化,大幅提升推理速度。

- NPU (神经网络处理器):专为 AI 计算设计的芯片,能效比极高,在边缘设备和手机上广泛使用。

- FPGA (现场可编程门阵列):可编程硬件,可以实现极致定化的流水线,延迟极低,但开发难度大,成本高。

模型优化

深度学习模型通常很“重”,需要对其进行优化才能满足实时性要求。

(图片来源网络,侵删)

- 模型轻量化:

- 剪枝:移除模型中不重要的神经元或连接。

- 量化:将模型权重从 32 位浮点数转换为 8 位整数,减小模型体积并加速计算。

- 知识蒸馏:用一个大的“教师模型”去指导一个小型的“学生模型”进行学习,让学生模型在保持性能的同时变得更小。

- 模型选择:选择本身就轻量级的模型架构,如 MobileNet, YOLOv5/v8, EfficientNet 等。

并行与流水线处理

为了最大化硬件利用率,必须采用并行和流水线设计。

- 多线程/多进程:将流水线的不同阶段分配到不同的线程中执行,一个线程负责从摄像头读取数据,另一个线程负责解码,第三个线程负责推理。

- 异步 I/O:使用非阻塞的 I/O 操作,避免在等待数据(如从网络读取)时阻塞整个程序。

- 流水线重叠:在处理当前帧的同时,可以开始读取下一帧,实现“生产-消费”模式,隐藏 I/O 和解码的延迟。

典型应用场景

实时摄像数据处理技术已经渗透到各行各业:

-

智慧安防

- 应用:人脸门禁、陌生人闯入报警、车辆识别与追踪、异常行为检测(如摔倒、打架)。

- :人脸识别、目标检测、行为分析。

-

自动驾驶

- 应用:实时识别车道线、交通信号灯、行人、其他车辆、路标。

- :多传感器融合(摄像头 + 激光雷达 + 毫米波雷达)、目标检测与追踪、语义分割。

-

工业质检

- 应用:在生产线上实时检测产品表面的瑕疵(划痕、污点)、零件装配是否正确、读取产品上的二维码/条形码。

- :图像分类、缺陷检测、OCR。

-

智慧零售

- 应用:客流统计与分析、顾客行为分析(如拿取商品、在货架前停留时间)、无人结算。

- :目标检测与追踪、人体姿态估计。

-

直播与视频会议

- 应用:虚拟背景、美颜滤镜、实时字幕、手势识别、表情识别。

- :图像分割、人脸关键点检测、OCR、手势识别。

-

医疗影像

- 应用:在手术中实时辅助医生定位病灶、内窥镜图像增强与分析。

- :图像分割、目标检测。

挑战与解决方案

| 挑战 | 描述 | 解决方案 |

|---|---|---|

| 高延迟 | 从采集到输出的时间过长,影响实时性。 | 硬件加速:使用 GPU/NPU/FPGA。 算法优化:模型轻量化、量化。 流水线并行:多线程、异步处理,最大化硬件利用率。 |

| 低吞吐量 | 每秒能处理的帧数低,无法满足高分辨率或高帧率视频的需求。 | 优化计算内核:使用 CUDA/OpenCL 编写核心算法。 批处理:将多帧图像打包成一个批次送入模型推理,提高 GPU 利用率。 |

| 资源受限 | 在嵌入式设备或边缘设备上,计算、内存、功耗都非常有限。 | 模型轻量化:剪枝、量化、知识蒸馏。 边缘计算:在设备端完成处理,减少数据上传。 选择合适硬件:采用 NPU 或低功耗 GPU。 |

| 数据质量差 | 摄像头抖动、光照变化、运动模糊、遮挡等问题影响算法效果。 | 图像预处理:图像稳定、直方图均衡化、去噪。 鲁棒性模型:训练能适应不同环境的模型。 多模态融合:结合陀螺仪等其他传感器数据。 |

| 系统稳定性 | 程序可能因内存泄漏、异常输入或算法错误而崩溃。 | 异常处理:对输入数据进行校验,增加 try-catch 块。 资源监控:监控 CPU、内存、GPU 使用率,进行降级处理。 模块化设计:将系统解耦,一个模块的崩溃不影响整体。 |

摄像实时数据处理是一个典型的“软硬结合”的领域,构建一个高效、稳定的实时系统,需要:

- 清晰的架构设计:理解并构建一个优化的数据处理流水线。

- 强大的算法能力:选择并优化合适的算法和模型。

- 深厚的工程功底:熟练运用编程语言、并行计算和硬件加速技术。

- 对场景的深刻理解:针对具体应用的需求和挑战,做出合适的权衡。

随着 AI 和硬件技术的不断发展,实时处理的边界正在被不断拓宽,应用场景也将更加丰富。

文章版权及转载声明

作者:咔咔本文地址:https://www.jits.cn/content/33605.html发布于 04-20

文章转载或复制请以超链接形式并注明出处杰思科技・AI 股讯

还没有评论,来说两句吧...