如何高效下载并实时更新网站数据?工具与技巧全解析

摘要:

我们需要明确“实时数据”通常指以下几种:公开数据:网站直接展示给所有人的数据,如股票价格、天气信息、新闻列表、商品价格等,这是最容易获取的,动态加载的数据:数据通过 JavaScr...

摘要:

我们需要明确“实时数据”通常指以下几种:公开数据:网站直接展示给所有人的数据,如股票价格、天气信息、新闻列表、商品价格等,这是最容易获取的,动态加载的数据:数据通过 JavaScr... 我们需要明确“实时数据”通常指以下几种:

- 公开数据:网站直接展示给所有人的数据,如股票价格、天气信息、新闻列表、商品价格等,这是最容易获取的。

- 动态加载的数据:数据通过 JavaScript (AJAX/Fetch) 动态加载到页面中,而不是在初始 HTML 源代码里,比如社交媒体的动态、电商的无限滚动加载。

- 需要登录的数据:数据只有在用户登录后才能看到。

- 需要交互的数据:数据需要用户进行某种操作(如点击、输入)才会生成或更新。

下面我将根据这些情况,为你介绍不同的下载方法。

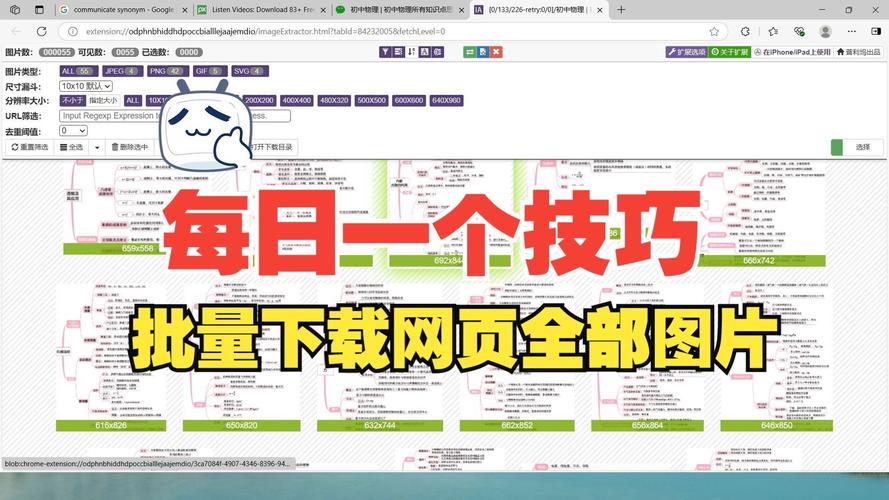

(图片来源网络,侵删)

浏览器开发者工具(最简单,适合公开数据)

这是最直接、最快捷的方法,无需任何编程知识,适合获取已经加载到浏览器中的数据。

适用场景:数据可以直接在网页上看到,即使是动态加载的,只要加载完成就可以拿到。

操作步骤:

- 打开目标网站,在浏览器中找到你想要的数据所在的页面。

- 打开开发者工具:

- 按

F12键,或者 - 右键点击页面,选择“检查”(Inspect)。

- 按

- 切换到“网络”(Network)标签页。

- 刷新页面,Network 面板会列出页面加载的所有请求。

- 筛选请求:

- 在过滤框中输入

fetch、xhr或api,这些关键词通常代表 AJAX/Fetch 请求,也就是网站用来动态加载数据的接口。 - 找到你想要的数据对应的请求,你可以通过点击请求,在“标头”(Headers)或“预览”(Preview)标签页中查看内容,确认是不是你要的数据。

- 在过滤框中输入

- 获取数据:

- 直接复制:在“响应”(Response)或“预览”标签页,可以直接复制 JSON 格式的数据。

- 复制链接:在“标头”标签页,找到“请求 URL (Request URL)”,这就是数据的真实来源,你可以把这个链接复制下来,用其他工具(如 Postman)直接访问,或者用编程语言(如 Python)去请求它。

优点:

(图片来源网络,侵删)

- 无需编程,直观快速。

- 能找到网站隐藏的数据接口。

缺点:

- 只能获取已加载的数据,无法实现真正的“实时”轮询。

- 网站更新接口后,需要重新查找。

- 无法获取需要登录或复杂交互才能产生的数据。

编写脚本(最强大、最灵活)

这是实现自动化、定时获取“实时”数据最专业的方法,使用 Python 语言配合一些强大的库,可以轻松应对绝大多数场景。

核心工具:Python

requests库:用于发送 HTTP 请求,获取网页的初始 HTML。BeautifulSoup4库:用于解析 HTML,方便地提取数据。Selenium库:用于模拟浏览器操作,可以处理 JavaScript 渲染的页面和进行用户交互。pandas库:用于处理和分析获取到的数据,并可以方便地导出为 Excel、CSV 等格式。

数据在初始 HTML 中(静态网页)

如果数据直接写在 HTML 标签里,这是最简单的情况。

import requests

from bs4 import BeautifulSoup

# 1. 发送 HTTP 请求

url = 'https://example.com/news' # 替换成目标网址

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

response = requests.get(url, headers=headers)

# 2. 解析 HTML

soup = BeautifulSoup(response.text, 'html.parser')

# 3. 提取数据 (需要用浏览器开发者工具找到具体的标签和 class)

# 提取所有新闻标题s = soup.find_all('h2', class_='news-title') # 根据实际情况修改

# 4. 处理和保存数据in news_titles:

print(title.text.strip())

# 可以将数据存入列表,然后用 pandas 导出为 Excel

data = [{'title': t.text.strip()} for t in news_titles]

import pandas as pd

df = pd.DataFrame(data)

df.to_excel('news_titles.xlsx', index=False)

数据通过 JavaScript 动态加载(AJAX/API)

这是现代网站最常见的情况,你需要找到那个 API 接口,然后用 requests 直接请求它。

import requests

import json

import time

# 1. 使用方法一找到 API 接口 URL

api_url = 'https://api.example.com/v1/realtime-data' # 替换成你找到的接口

# 2. 设置请求头,有些 API 需要 Referer 或 Origin

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

'Referer': 'https://example.com' # 通常是原始网页的地址

}

# 3. 模拟“实时”获取(定时轮询)

while True:

try:

response = requests.get(api_url, headers=headers)

# 有些 API 返回的是 JSON 字符串,需要解析

data = response.json()

print(f"获取到数据: {data['value']} at {time.strftime('%Y-%m-%d %H:%M:%S')}")

# 将数据追加到文件

with open('realtime_data_log.txt', 'a') as f:

f.write(f"{time.strftime('%Y-%m-%d %H:%M:%S')}, {data['value']}\n")

except Exception as e:

print(f"发生错误: {e}")

# 每隔 5 秒获取一次

time.sleep(5)

需要登录或复杂交互

如果数据需要登录才能看到,或者需要点击按钮、滚动页面等操作,就需要 Selenium 来模拟浏览器行为。

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.chrome.service import Service

from webdriver_manager.chrome import ChromeDriverManager

import time

# 1. 设置 Selenium

options = webdriver.ChromeOptions()

# options.add_argument('--headless') # 如果不需要看到浏览器界面,可以取消注释

driver = webdriver.Chrome(service=Service(ChromeDriverManager().install()), options=options)

# 2. 打开网站并登录

driver.get('https://example.com/login')

driver.find_element(By.ID, 'username').send_keys('your_username')

driver.find_element(By.ID, 'password').send_keys('your_password')

driver.find_element(By.ID, 'submit-button').click()

# 3. 等待登录完成,并进行操作(如点击某个按钮)

time.sleep(3) # 简单等待,实际项目中最好用显式等待

driver.find_element(By.ID, 'load-data-btn').click()

# 4. 等待数据加载,然后提取

time.sleep(5) # 给足够的时间让 JS 渲染数据

data_element = driver.find_element(By.ID, 'dynamic-data-container')

print(data_element.text)

# 5. 关闭浏览器

driver.quit()

使用现成的工具(适合非技术人员)

如果你不想写代码,可以尝试一些现成的工具。

- Octoparse / ParseHub:这些是可视化网页抓取工具,你只需要在浏览器里像人一样点击、选择数据,工具就会自动记录你的操作并生成抓取流程,它们可以处理分页、动态加载等复杂情况,并且可以定时运行。

- Excel Power Query:在 Excel 中,你可以使用“获取数据” -> “从网页”功能,它内置了一些简单的抓取能力,对于结构化的静态表格数据非常方便,对于动态数据,效果可能不佳。

- IFTTT (If This Then That):如果数据源有提供 RSS Feed 或 API,并且你的目标(如 Google Sheets、Dropbox)也支持,可以使用 IFTTT 来创建自动化流程,实现数据的自动同步。

重要注意事项与伦理

robots.txt:在抓取任何网站之前,请务必检查其robots.txt文件(https://example.com/robots.txt),这个文件告诉爬虫哪些页面可以抓取,哪些不可以,尊重网站的规则是基本的网络礼仪。- 服务条款:仔细阅读网站的服务条款,其中可能明确禁止自动化访问或数据抓取,违反条款可能会导致你的 IP 被封禁。

- 频率限制:不要过于频繁地请求服务器,这会给对方网站带来巨大压力,甚至导致你的 IP 被封,在脚本中加入

time.sleep()是一个好习惯。 - 数据所有权:你抓取的数据可能受版权保护,明确你使用这些数据的目的,并遵守相关法律法规。

- 反爬虫机制:现代网站都有反爬虫措施,如验证码、IP 封禁、请求头检查等,高级的爬虫可能需要使用代理 IP、验证码识别服务(如 2Captcha)等技术来绕过。

总结与建议

| 方法 | 难度 | 适用场景 | 优点 | 缺点 |

|---|---|---|---|---|

| 浏览器开发者工具 | ⭐ | 获取公开的、已加载的静态或动态数据 | 无需编程,直观快速 | 无法自动化,不持久 |

| Python 脚本 | ⭐⭐⭐ | 所有场景,尤其是需要自动化、定时、处理复杂交互 | 功能最强大,最灵活,可定制性高 | 需要编程知识,维护成本高 |

| 现成工具 | ⭐ | 结构化数据,非技术人员快速上手 | 图形化界面,易于上手 | 功能受限,可能收费,灵活性差 |

给你的建议:

- 新手入门:从 方法一(浏览器开发者工具) 开始,了解数据是如何加载的。

- 想要自动化:学习 方法二(Python 脚本),这是最核心、最强大的技能,从

requests+BeautifulSoup开始,逐步学习Selenium。 - 不想写代码:尝试 方法三(现成工具),如 Octoparse,看看是否能满足你的需求。

希望这份详细的指南能帮助你成功获取所需的网站实时数据!

文章版权及转载声明

作者:咔咔本文地址:https://www.jits.cn/content/34498.html发布于 04-26

文章转载或复制请以超链接形式并注明出处杰思科技・AI 股讯

还没有评论,来说两句吧...